谷歌端侧AI模型内存仅2GB谷歌2GB多模态模型Gemma3n

谷歌发布了支持手机部署的AI模型,仅占2GB内存,还支持推理。

在2025年5月21日的I/O开发者大会上,谷歌推出了轻量级多模态模型Gemma 3n。

它可以在手机、平板、笔记本等常见终端上实现本地部署,无需联网即可处理语音、图像、文字甚至视频。

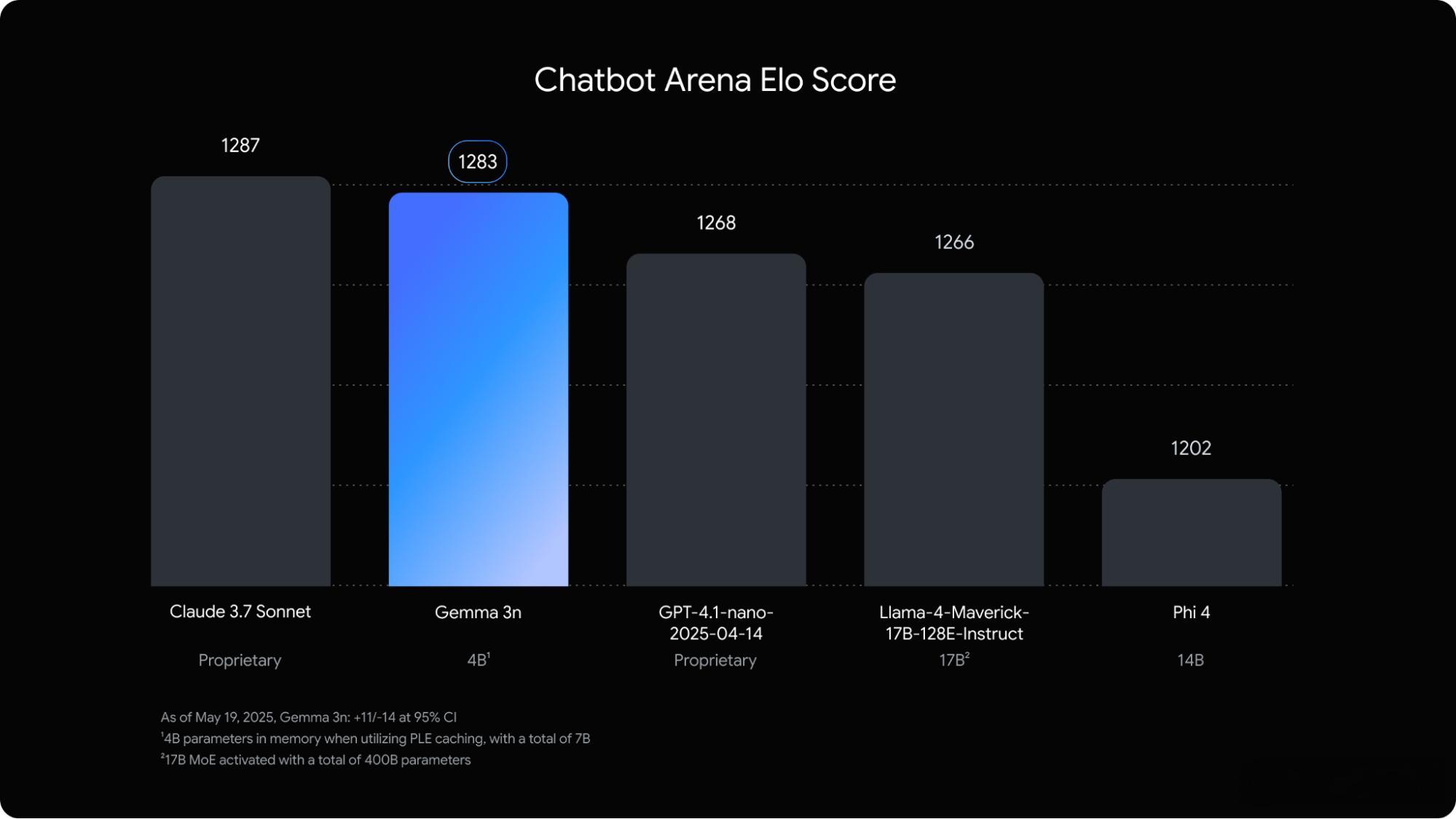

在Chatbot Arena大模型竞技场上,Gemma 3n超越了GPT-4.1-nano和Llama-4-17B。

该模型使用了DeepMind提出的PLE技术(每层嵌入,Per-Layer Embeddings),尽管其参数量分别为5B和8B,但内存占用仅相当于2B和4B模型。

借助MatFormer训练框架,Gemma 3n支持“性能优先”和“质量优先”模式的灵活切换,可根据任务需求动态调整适配策略。

而且所有推理过程,均可在设备端完成,不依赖云端,适合对隐私敏感的应用场景。

目前可通过Google AI Studio直接在浏览器中使用Gemma 3n;开发者则可通过Google AI Edge部署到Android等设备上。

感兴趣的小伙伴可以点击: