当量子计算跟AI结合起来,会发生什么?

长期以来,行业一直面对一个难题:如何把现实世界的海量非量子数据(如餐厅评论、RNA 序列)高效地喂给量子计算机,而不至于让设备“撑死”。因为,学术界高度怀疑量子计算机处理大规模现实数据的能力。

而刚刚,来自 Oratomic 公司和加州理工学院(Caltech)的研究团队提出了一项数学分析,证明了量子计算机在处理大规模机器学习任务时具有真实的、近期的优势。

以前人们认为,要让量子计算机处理数据,必须先将所有数据存入一个巨大的“量子内存”并进入叠加态,但这需要天文数字级别的存储设备,物理上几乎不可能实现。 研究团队证明了“小批量、流式输入”的可行性。这就像看电影不再需要把 100GB 的文件全下完,而是边看边播。量子计算机可以分批次吞掉数据,并利用其量子特性进行高效学习。这彻底甩掉了对巨型量子内存的依赖。

该分析指出,一台拥有 300 个逻辑量子比特(Logical Qubits) 的量子计算机,在处理特定数据任务时,其表现将超过一台“用可观测宇宙中所有原子制造”的经典计算机。量子比特的叠加特性允许它在极小的内存代价下处理极高维度的数据特征。这种内存优势不是百分比的提升,而是指数级的跨维度打击。当经典 GPU 还在为显存溢出抓耳挠腮时,量子芯片已经处理完了整个宇宙级别的参数。

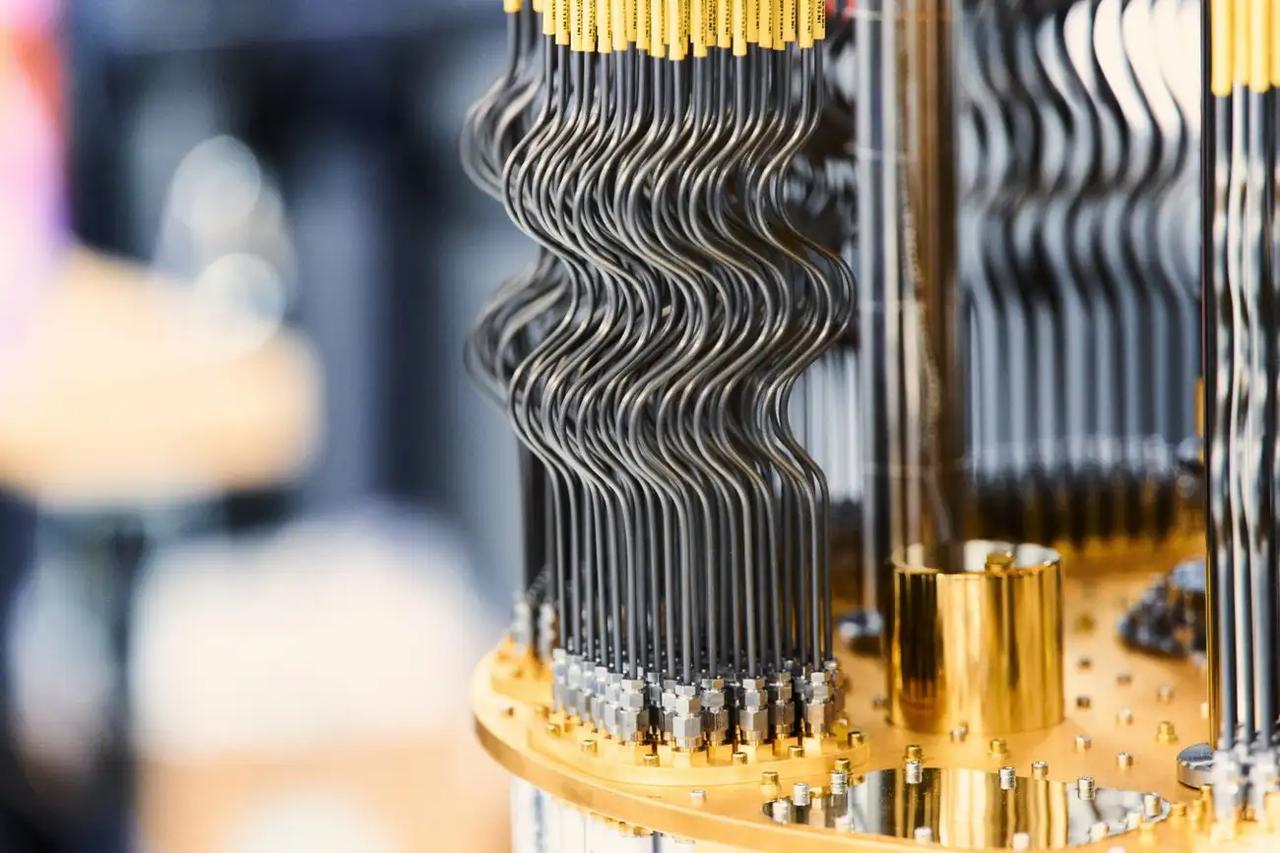

300 个逻辑比特可能还很远,但研究指出,60 个逻辑量子比特就足以在特定大数据处理任务中显现出超越经典计算机的优势。按照目前的硬件进化速度,60 个逻辑比特有望在 2030 年前实现。这意味着量子 AI 不再是“下个世纪的事”,它在大型科学实验(如大强子对撞机的海量数据筛选)中具有迫切的实战价值。

所以这么看起来,量子计算真的会成为 AI 进化的终极助推器。