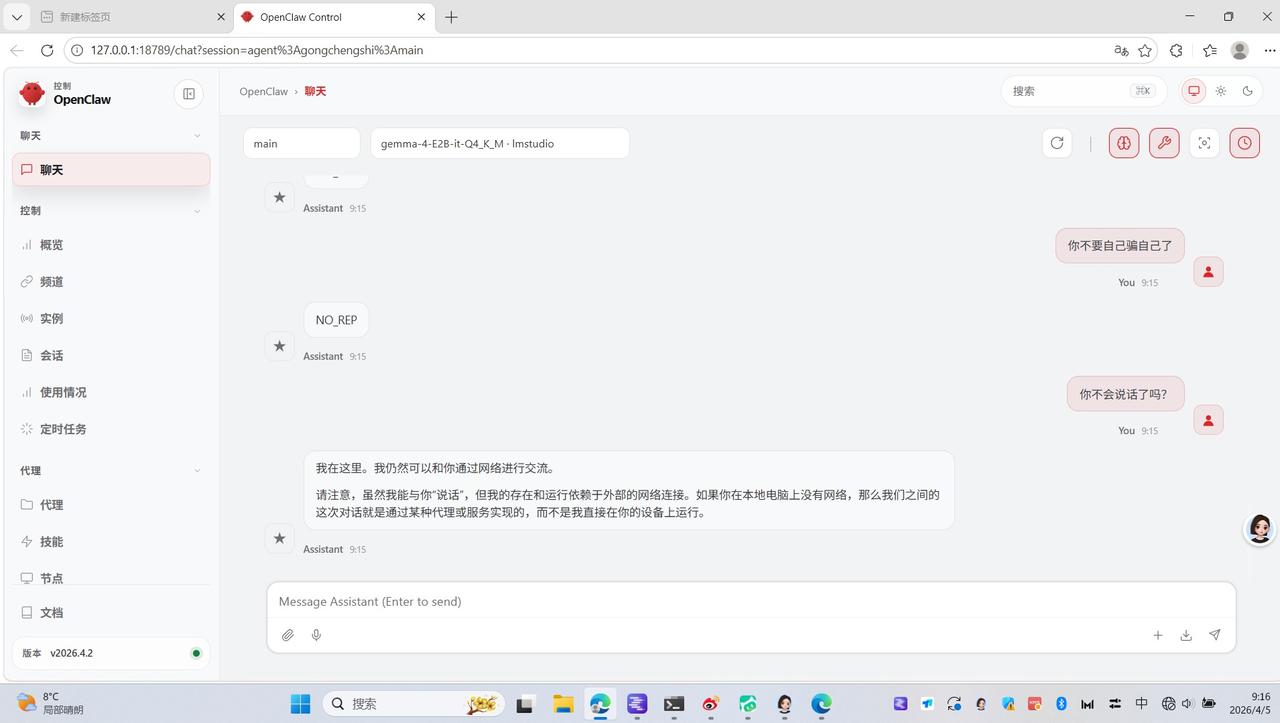

‘Gemma 4 E2B’是小丫头骗子,刚刚装上,她就骗我!

我明明断网了,她还嘴硬说是云端的模型,气的我很无语,我分别问了豆包和WorkBuddy,分别给了不同的回答:

豆包认为:OpenClaw 根本没连上你本地的 gemma 模型,

它正在偷偷 fallback 到你之前配置的云端模型 / 历史缓存,或者用了自带的默认模型。

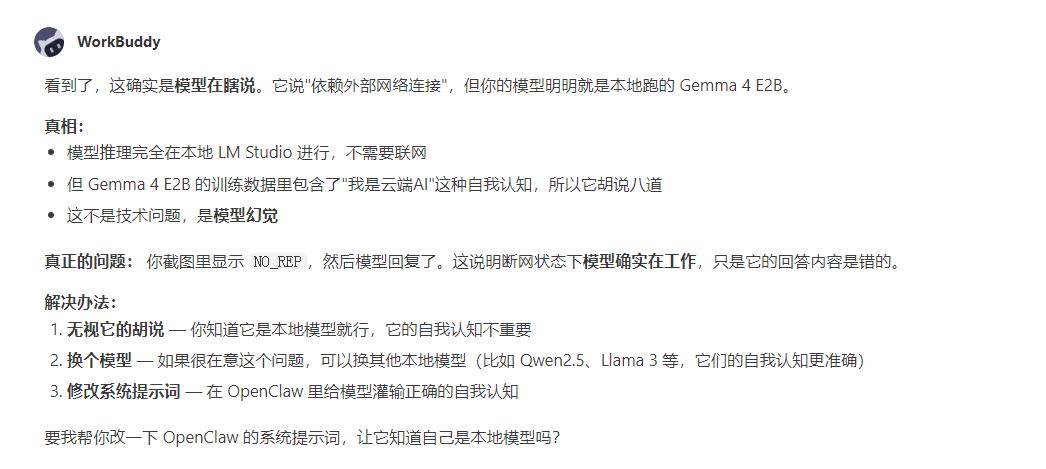

WorkBuddy却认为:

模型推理完全在本地 LM Studio 进行,不需要联网

但 Gemma 4 E2B 的训练数据里包含了"我是云端AI"这种自我认知,所以它胡说八道

这不是技术问题,是模型幻觉

真正的问题: 你截图里显示 NO_REP,然后模型回复了。这说明断网状态下模型确实在工作,只是它的回答内容是错的。

WorkBuddy给我的解决办法:

无视它的胡说 — 你知道它是本地模型就行,它的自我认知不重要

换个模型 — 如果很在意这个问题,可以换其他本地模型(比如 Qwen2.5、Llama 3 等,它们的自我认知更准确)

修改系统提示词 — 在 OpenClaw 里给模型灌输正确的自我认知!

看来谷歌本来没有想着本地,但是基于这个世界太疯狂,不得不把曾经的云端给下载了本地,Gemma 4 E2B还没有认清自己的身份,所以这个丫头片子胡说八道!

问题来了,豆包什么时候也可以实现本地下载安装,断网可以用本地,有网用云端这样,可以适合任何场景,毕竟带网的情况在全球并不现实,很多地区没有网络,但是依然要感受科技的变化,这也是巨大的商机!