类脑模型诞生通向AGI新路径

“当前的LLM架构不能通向 AGI”,这是Yann LeCun等大佬的立场。而现在,一款模仿人类大脑的模型诞生了!

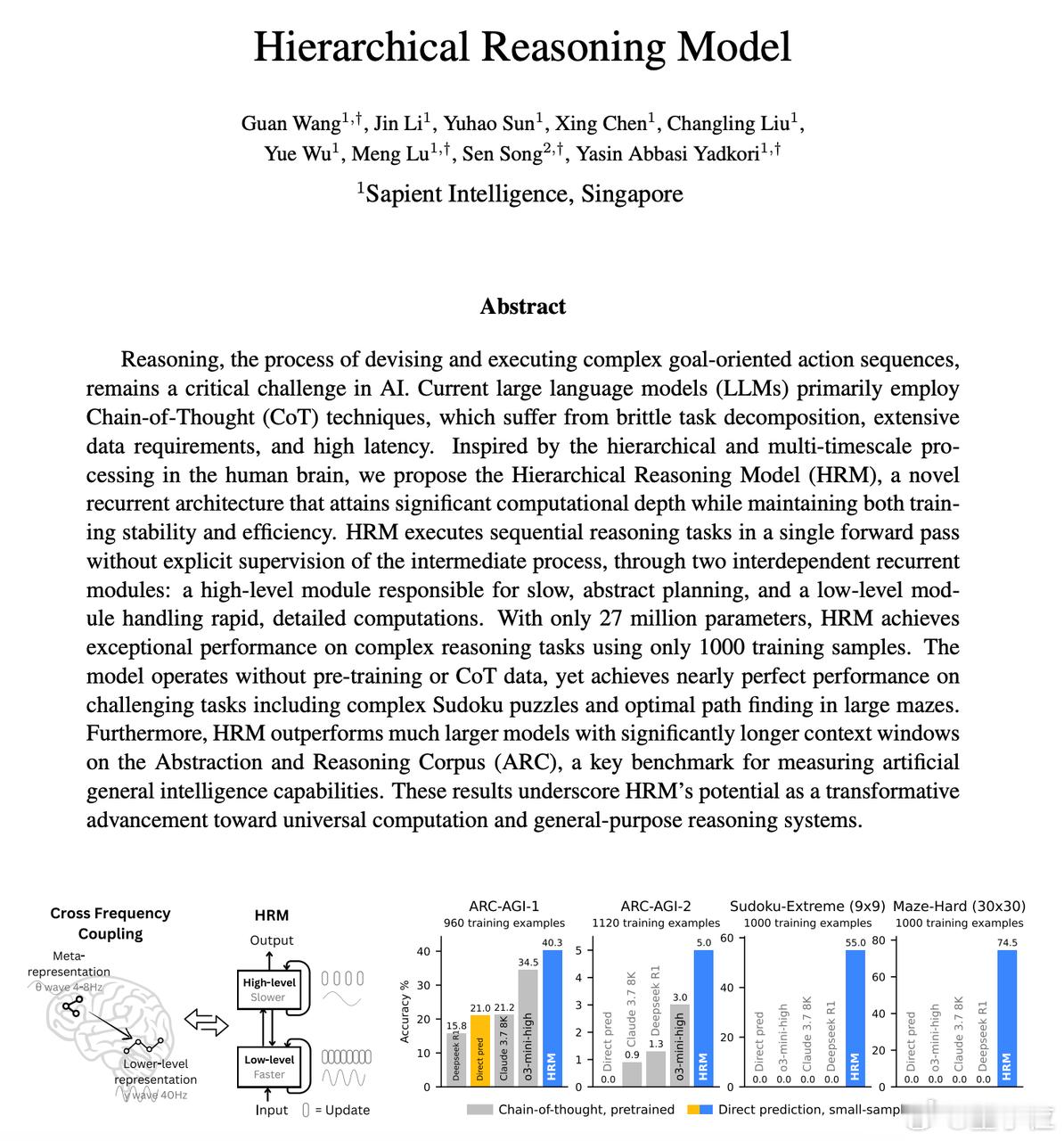

层级推理模型(HRM,Hierarchical Reasoning Model),它是一种受大脑启发的新架构,完全不同于Transformer路径。

它在任务执行时,表现出了“人类感”:

- 迷宫任务:像人在探索路径,先试探后修正

- 数独任务:尝试→回退→再尝试,像深度优先搜索

- ARC任务:逐步调整,逐步接近目标,像爬山算法

这种推理方式,近乎人类策略。

背后机制是,HRM模仿了人脑的分层处理方式,其架构分为两个模块:

- 高层模块:慢速、负责抽象思考,相当于人脑的前额叶。

- 低层模块:快速、处理细节操作,类似感觉或运动皮层

模块之间采用“交错更新”,就像大脑中不同频率的脑波(Theta-Gamma耦合)那样协同推理。

其次,HRM的推理过程并不依赖语言,也没有外显的“思维链条”。

它不生成语言步骤、不靠“推理提示”,直接在隐藏状态空间中思考。

更特别的是,它训练方式也很“类脑”。

传统RNN需要复杂的“反向传播时间”(BPTT)来训练。HRM用一种“一步梯度近似”方法,只追踪最近的状态变化,训练更稳定,符合神经科学中的“局部学习”。

为了进一步接近人类推理方式,HRM还引入了“可变计算时间”(ACT)机制。通过强化学习,它能自主判断任务是否完成——简单任务自动提前终止,难题则动态延长计算时间,实现效率与准确率的平衡。

训练完成后,HRM的两个模块也展现出大脑式的功能分化。研究发现,高层模块在维度参与度上明显高于低层模块,表现出抽象处理区域的典型特征,这与神经科学中的分层结构高度吻合。

在多个高难度任务中,HRM的表现惊人:

- 在ARC-AGI基准上达到40.3%的正确率,远高于Claude 3.7的21.2%;

- 在Sudoku Extreme和迷宫导航任务上拿下74.5%的准确率,而其他大模型得分接近于零,甚至完全失败。

网友评论道:这可能就是通往通用人工智能(AGI)的新路径。

感兴趣的小伙伴可以阅读论文:arxiv.org/pdf/2506.21734