在这次AI Talk里,李想大大方方地承认,在将传统端到端方案的视觉-动作模型VA改造为视觉-语言-动作模型VLA的过程中,理想汽车在语言模型上选择了DeepSeek开源的语言模型。

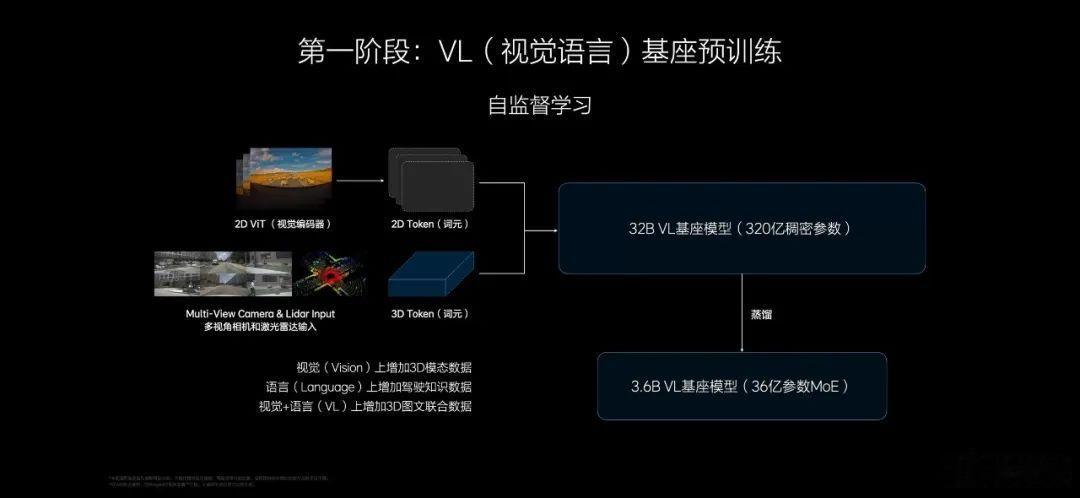

DeepSeek-VL2大致包含视觉编码器、视觉语言适配器和语言模型三个部分。但理想VLA在预训练阶段并没有完全照搬DeepSeek-VL2,而是在其视觉编码器部分增加了3D模态数据,在视觉语言适配器部分增加了3D图文联合数据,并在语言Token中增加驾驶知识数据,其语言模型则照搬了DeepSeek-VL2里的语言模型。

立志在数字AI领域杀入前三的理想汽车之所以使用DeepSeek的成果,一则是因为DeepSeek模型的能力实在很强悍,二则是因为人家选择了比较彻底的开源方式,可以帮助抠厂省钱。

根据理想的官方消息,它早在一年前就开始追踪DeepSeek的进展,并在2024年7月份使用了DeepSeek-VL做产线质检。

这次又将去年12月份开源的DeepSeek-VL2用在了自己的VLA模型里面,据称可以节省9个月的研发时间,省下好几个小目标的钱! 新能源大牛说