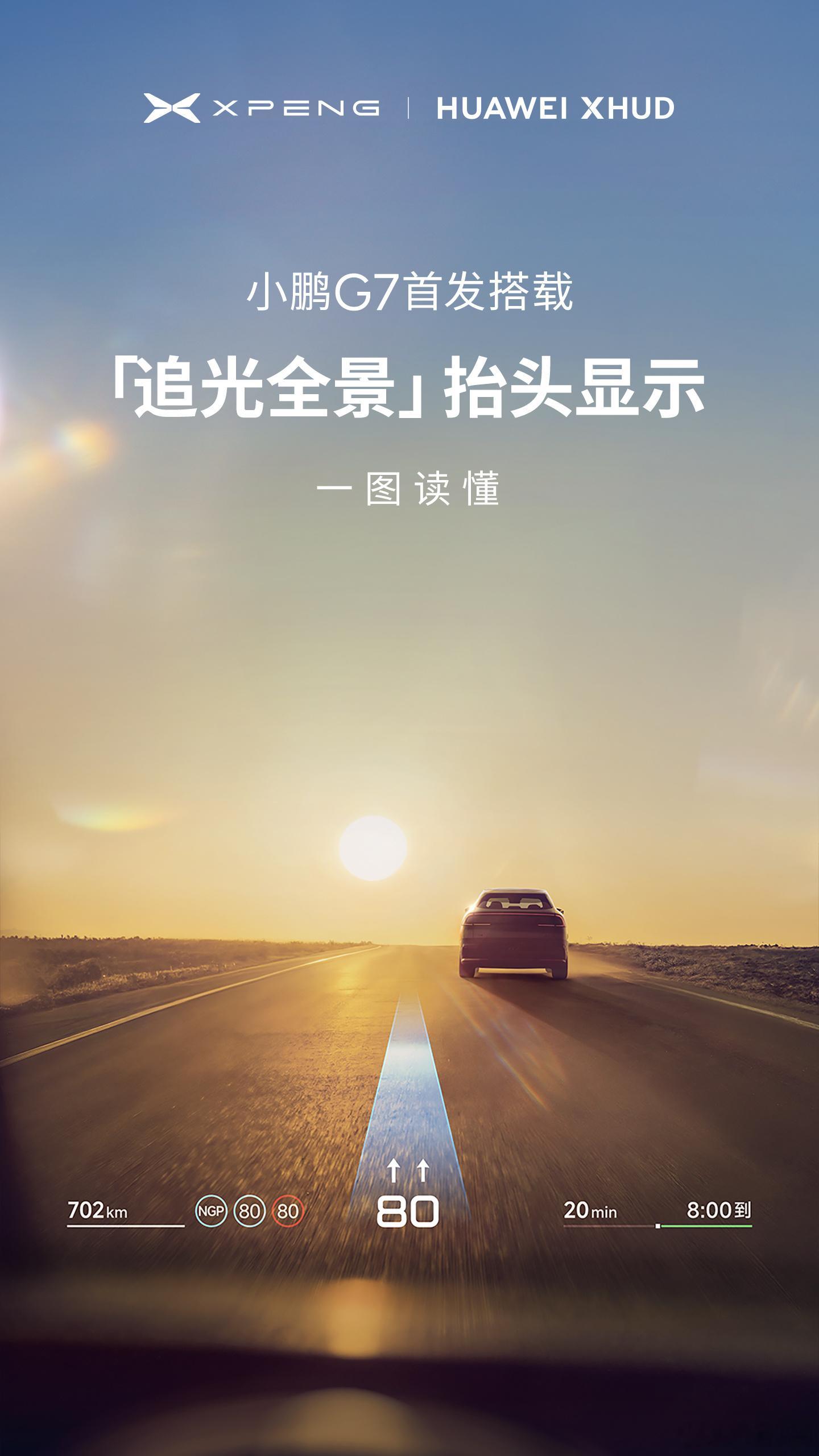

看完今天小鹏和华为的XHUD发布会上G7首发搭载的“追光全景”抬头显示,他们说的“三大创新场景”、“解决三大行业痛点”固然厉害,但我认为XHUD的意义并不仅仅是一个更先进的HUD,而是对AI对驾驶这一人类日常行为从感知模式、决策逻辑乃至社会评价方式的深层重构。

在小鹏优异的AI能力的加持下,XHUD通过强大虚实交互能力,实质上建造了一套面向现实的操作系统——其颠覆性不在于呈现多少虚拟元素,而在于将现实世界转化为可计算、可编程、可扩展的数字物理混合体。当物理空间获得软件的灵活性,当数字信息获得物质的持久性,我们或许正见证人类驾驶范式的重大跃迁。

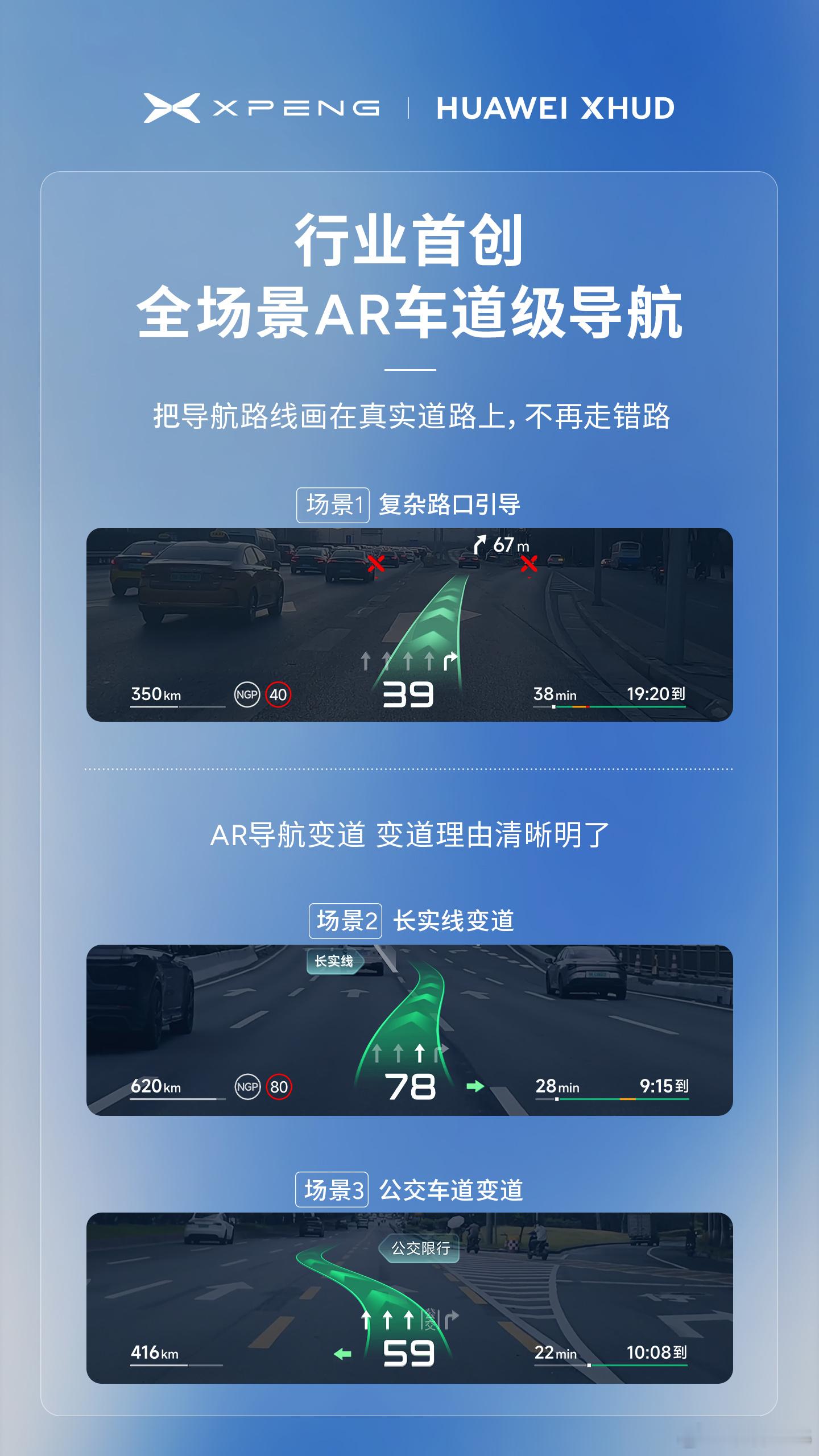

传统的驾驶行为,驾驶员感知周围的信息主要通过可见的视觉和部分听觉,而这次的XHUD则将全车360度数十个高精度感知硬件整合,实现了虚拟信息与物理空间的像素级贴合,就像鱼头说的那样,每一个图标都贴合到了真实的世界里,每一个显示的内容都是基于此时此刻现实的环境。这标志着驾驶过程中的人机交互从“平面范式”向“空间范式”的进化,人类司机的感知从眼前的视觉、传统屏幕、平面HUD等等平面,拓展到了车辆周围整个的空间,堪称对人类传统驾驶行为在感知上的重构。

XHUD通过结合智驾系统,实现了虚拟对象对环境的动态响应,这也是我认为的最重大的突破。光毯会随着现实道路的曲率和坡度进行实时调节,道路上不同的道路被标记了对错、不同的交通参与者根据对其事故概率的预判登记被标记了高低危险系数……XHUD将物理世界转化为了一个个数字超级对象,实现了从信息感知到情境智能的巨大跨越。通过光毯、道路AR标记、VRU危险系数等等超级对象,将大量人眼看不见人脑想不到的信息高效传递给了驾驶员,XHUD真正实现了AI辅助人类决策,将“我见即我知”变成了“我知即我见”,重构了日常驾驶的逻辑。

法律根植于社会,是最低层面的道德。法律对于驾驶行为的评价,是基于驾驶员人眼、人脑对于周围环境的有限感知与即时决策。当人眼的感知不再局限于有限的角度和照度,当人脑的决策不再仅基于肉眼所见,当人眼可以提前3秒钟预判鬼探头的威胁、当人脑在从来没有去过的城市也对城市角落如数家珍,法律对于驾驶行为的评价也必将被重构。

这场革命才刚刚撕开序幕,但要看见未来,除了XHUD我猜还不够,期待后面小鹏再掏一堆的新玩意,触摸到虚实交织的未来蓝图。小鹏G7全球首发小鹏华为联合研发ARHUD小鹏华为ARHUD联手小鹏汽车[超话]